IVE dan LE SSERAFIM Jadi Korban Pelecehan Seksual dari Penggunaan AI, Majelis Hukum Buat Aturan Baru Ini!

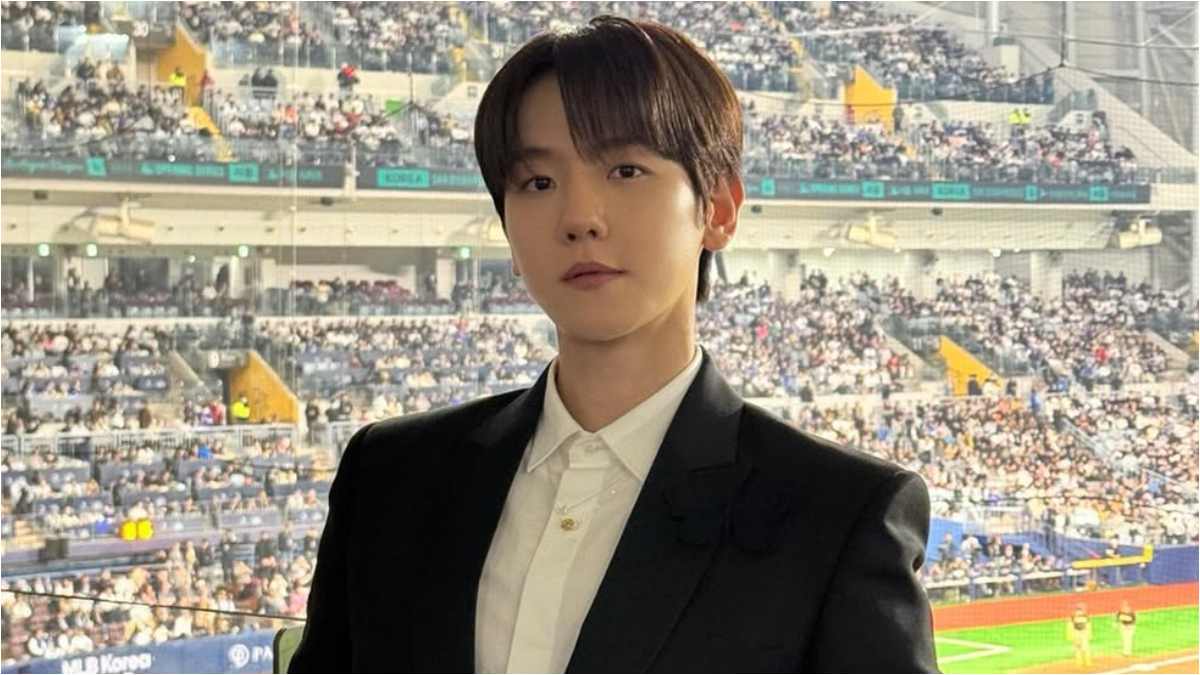

Teknologi AI memungkinkan orang tak bertanggungjawab buat konten pornografi dengan wajah idol KPop termasuk IVE dan LE SSERAFIM.

KPOPCHART.NET - IVE dan LE SSERAFIM dilaporkan jadi korban pelecehan seksual oleh orang yang tak bertanggung jawab.

Melansir dari Daum, member IVE dan LE SSERAFIM dengan penggunaan Artificial Intelligence (AI) dijadikan objek seksual dimana fotonya di-edit sedemikian rupa menyerupai bintang film dewasa.

Foto para member IVE dan LE SSERAFIM yang telah disunting tersebut kemudian tersebar secara online dan buat penggemar terkejut.

Pada hari ini (27/06), industri terkait melaporkan bahwa AI sudah banyak digunakan untuk mengenali foto para idola populer seperti IVE dan LE SSERAFIM yang telah diunggah di CivitAI.

CivitAI sendiri merupakan situs berbagi foto hasil kerja AI yang di dalamnya telah terisi banyak potret idol wanita termasuk LE SSERAFIM dan IVE.

Foto palsu LE SSERAFIM dan IVE ramai dibuat karena AI bisa menghasilkan gambar deepfake dan punya fitur yang mudah digunakan banyak orang tak bertanggung jawab dengan PC mereka sendiri.

LE SSERAFIM, IVE, dan para idol lain jadi korban terbesar dalam proses pembuatan foto palsu yang sangat High Definition (HD) berkaitan dengan kejahatan pornografi dan jumlah hasil editannya disebutkan semakin meningkat.

Tak hanya foto, video palsu berbau pornografi dengan wajah LE SSERAFIM, IVE, dan idol-idol KPop lainnya ternyata juga kerap diunggah dengan menggunakan teknologi AI.

Baca Juga: Lagu 3 Idol HYBE Suga BTS, LE SSERAFIM, dan NewJeans Masuk dalam Daftar Ini di LA Times!

Kasusnya meningkat, Majelis Hukum Nasional Korea Selatan baru-baru ini merevisi 'Hukuman Tindakan Kejahatan Pemalsuan Mendalam (Deepfake).'

Seseorang yang mendistribusikan konten deepfake akan dihukum 5 tahun penjara dan denda mencapai 50 Juta Won atau lebih dari 576 Juta Rupiah.

Lalu, mendistribusikan konten deepfake untuk mendapatkan keuntungan akan ditahan selama 7 tahun penjara.

Produksi dari konten deepfake pornografi di Korea Selatan disebutkan semakin hari semakin meningkat dan sudah jadi masalah serius.

Level dari hukuman yang diberikan pada penggunaan AI secara tak bertanggung jawab juga meningkat, tetapi pembuatan tekologi AI semakin canggih itu sendiri lah yang jadi masalah saat ini.

Melansir dari Daum, jumlah video seksual palsu yang dilaporkan Komisi Komunikasi Korea Selatan ke anggota kongres Heo Eun Ah untuk pengajuan revisi dan aturan pada tahun 2020 adalah 548 video.

Lalu, di tahun 2021 di mana teknologi AI semakin canggih jumlah video pornografi palsu meningkat tajam jadi 2988 kemudian, pada bulan Juli 2022 jumlahnya menjadi 2723.

Pada tahun 2022 lalu, 146 kejahatan terkait sudah dilaporkan dan dari jumlah tersebut hanya 63 kasus yang diproses.

Terkait dengan para idol yang dijadikan objek video pornografi palsu dengan teknologi AI, agensi hiburan di Korea Selatan sendiri disebutkan alami kesulitan untuk ajukan tangani hal tersebut.

Meski sudah ajukan gugatan, hanya sedikit kemungkinannya gugatan tersebut diproses dan pelaku mendapat hukuman.

Komentar

Masuk dengan akun komentator Weblu untuk menulis komentar.